ในความพยายามที่จะแก้ไขวิกฤติ Siri ที่ล้าหลังคู่แข่ง Apple กำลังพิจารณาก้าวที่อาจเรียกได้ว่า “ยอมแพ้” ด้วยการขอความช่วยเหลือจาก Google โดยอาจนำโมเดล AI Gemini มาใช้ขับเคลื่อน Siri เวอร์ชันใหม่

ตามรายงานล่าสุด ทั้งสองบริษัทยักษ์ใหญ่กำลังอยู่ในขั้นตอนเริ่มต้นของการเจรจาความร่วมมือ โดย Google จะปรับแต่งโมเดล Gemini ให้สามารถทำงานบนเซิร์ฟเวอร์ของ Apple ได้ ซึ่งจะช่วยเพิ่มความปลอดภัยและควบคุมข้อมูลผู้ใช้ได้ดีกว่า

ขณะเดียวกัน Apple กำลังพัฒนา Siri สองเวอร์ชันแบบขนาน ได้แก่:

- Linwood – ใช้โมเดล AI ของ Apple เอง

- Glenwood – พร้อมใช้เทคโนโลยีภายนอกอย่าง Gemini

บริษัทฯ ยังไม่ได้ตัดสินใจขั้นสุดท้ายว่าจะเลือกทางไหน

วิกฤติที่ Apple ไม่อยากยอมรับ

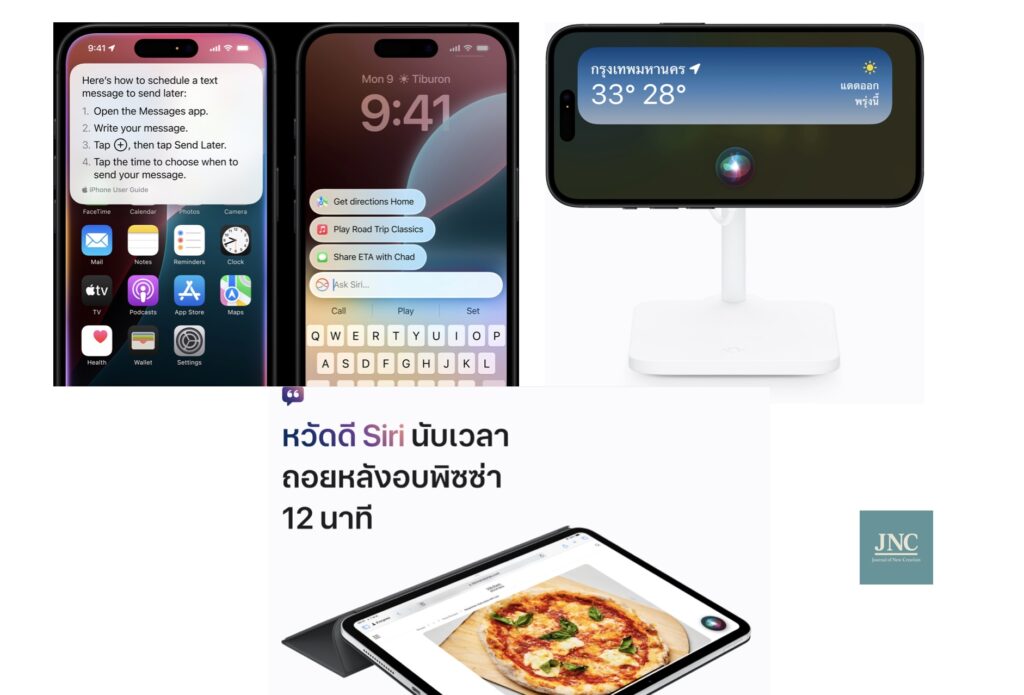

Apple เผชิญความยากลำบากอย่างมากในการพัฒนาฟีเจอร์ AI สำหรับ Siri ขณะที่โมเดล Gemini ของ Google มีความสามารถใกล้เคียงกับสิ่งที่ Apple เคยสัญญาไว้ และสามารถทำงานบน iOS ได้หากมีการปรับแต่งที่เหมาะสม

Siri ถูกมองว่าตกขบวนเมื่อเทียบกับคู่แข่งอย่าง ChatGPT, Google Assistant หรือแม้แต่ Alexa ที่ทำงานซับซ้อนได้มากกว่า เดิม Apple เคยพิจารณาให้ Gemini เป็นทางเลือกแทน ChatGPT ใน Apple Intelligence แต่ยังไม่เกิดขึ้นจริง หาก Apple ใช้ Gemini ในฟีเจอร์ AI ก็จะคล้ายกับ Samsung ที่ผสมผสานโมเดล Gemini กับโมเดลของตนใน Galaxy AI

โรดแมปที่สะดุด Siri ใหม่เลื่อนไปปี 2026

สถานการณ์ยิ่งตึงเมื่อ Apple ต้องประกาศเลื่อนการเปิดตัวฟีเจอร์ AI ใหม่ของ Siri—ที่ออกแบบให้เข้าถึงข้อมูลส่วนตัวและทำงานในแอปต่าง ๆ—จากกำหนดเดิมบน iOS 18 ออกไปเป็นปี 2026 ด้วยเหตุผลว่า “ฟีเจอร์ใหม่บางจุดทำงานได้เพียง 60–80%” ซึ่งไม่ผ่านมาตรฐานของบริษัท ส่งผลให้ต้องใช้เวลาปรับปรุงเพิ่มเติม

ความล่าช้าส่งผลต่อขวัญกำลังใจทีมพัฒนาอย่างมาก จนผู้บริหารต้องออกมาปลอบใจและให้กำลังใจทีมงานที่เผชิญแรงกดดันจากการเลื่อนเปิดตัว

เปลี่ยนโฟกัส เร่ง Apple Intelligence บนดีไวซ์

ระหว่างที่ Siri ใหม่ยังไม่พร้อม Apple เน้นพัฒนาฟีเจอร์ Apple Intelligence อื่น ๆ ที่ทำงานบนอุปกรณ์ เช่น การจัดการแบตเตอรี่ด้วย AI และคำแนะนำด้านสุขภาพ รวมถึงพิจารณา “แยก Siri ออกจาก Apple Intelligence” ในเชิงการตลาด

โจทย์ใหญ่ของ Apple คือการทำให้ AI “น่าเชื่อถือ–แม่นยำ–คงความเป็นส่วนตัว” ซึ่งเป็นค่านิยมหลักของบริษัท แต่ยากในบริบทเทคโนโลยีปัจจุบัน

Apple ตั้งเป้าให้การประมวลผล AI เกิดบนอุปกรณ์ (on-device) เพื่อความเป็นส่วนตัว ทว่าฟีเจอร์ขั้นสูงยังต้องพึ่งการประมวลผลผ่านเซิร์ฟเวอร์ของ Apple และชิปทรงพลังอย่าง M2 Ultra หรือ M4 ควบคู่ระบบรักษาความปลอดภัยข้อมูล

การพิจารณาใช้โมเดลภายนอกอย่าง Gemini จึงสะท้อนการยอมรับว่า “การพัฒนา AI ชั้นนำยากกว่าที่คาด” และความร่วมมือกับคู่แข่งอาจเป็นทางออกที่ดีที่สุดสำหรับผู้ใช้